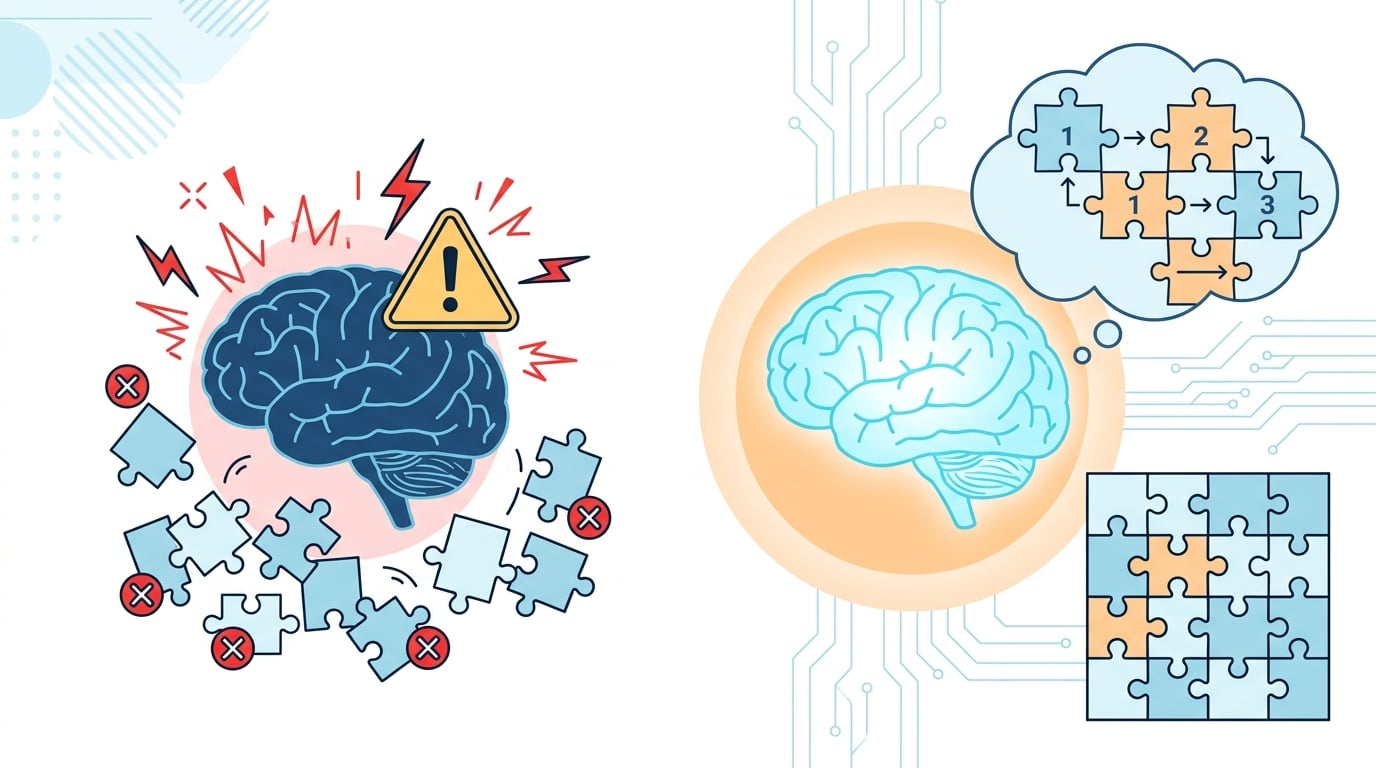

盲目行動的問題

在解決複雜邏輯問題或取得多項資訊時,強迫人工智慧立即決定採取某項行動,往往會導致災難性的錯誤。

想想人類是如何解拼圖的:

- 他們不會隨意抓一塊拼圖就塞進板子裡。

- 他們會在腦中或口頭上規劃策略: 「首先,我需要找出邊緣的平直拼圖,然後再看看這塊藍色的是否適合。」

同樣地,如果我們要求人工智慧 僅 只輸出一個行動——跳過推理階段——它就是「盲目行動」。由於尚未釐清回答問題所需的前置條件,它經常會猜測、幻覺化,或完全選錯工具。

大聲思考

語言模型是逐個詞元建構邏輯的。透過強制人工智慧「大聲思考」(生成分析問題的文字) 在 選擇行動之前,我們為它提供了必要的思考空間,以得出正確的邏輯結論。